پنج روش برای تشخیص تصاویر ساخته شده توسط هوش مصنوعی از تصاویر واقعی

ایران اکونومیستپلاس: با پیشرفت حیرتانگیز فناوریهای مبتنی بر هوش مصنوعی(AI)، خلق تصاویر جعلی باکیفیت دیگر کار چندان سختی نیست و امروزه هرکسی میتواند با اتصال به اینترنت و دسترسی به ابزارهای تصویرسازی مبتنیبر این فناوری، در عرض چندثانیه تصاویر جعلی واقعگرایانهای ایجاد کند که میتواند بسیاری از افراد را فریب دهد.

میدجورنی (Midjourney) که سال ۲۰۲۲ معرفی شد، یکی از معروفترین تصویرسازهای آنلاین مبتنی بر هوش مصنوعی است که تصاویر جعلی بسیار باکیفیتی تولید میکند. روند کار این ابزار به این صورت است که کاربران پس از ثبتنام، توضیحات متنی درخصوص موضوعات مدنظرشان را وارد میکنند و میدجورنی در عرض چند ثانیه، چندین تصویر جعلی با موضوع درخواستشده کاربران را میسازد.

ابزارهای هوش مصنوعی دیگری همچون Dall E۲، Stable Diffusion هم وجود دارند که توسط کمپانیهای دیگر توسعه یافتهاند و کارکردی مشابه میدجورنی دارند.

تصاویری که توسط این پلتفرمها ساخته میشوند به قدری واقعی و پرجزئیات به نظر میرسند که تاکنون میلیونها نفر را در سراسر دنیا گمراه کردهاند و در برخی از موارد به سختی میتوان تصویرهای جعلی ساخته شده توسط هوش مصنوعی را از تصاویر واقعی تشخیص داد و باعث شده تا کارشناسان درخصوص توسعه بیشتر این ابزارهای آنلاین مبتنی بر هوش مصنوعی و خطرات بالقوه آن هشدار دهند.

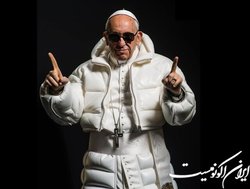

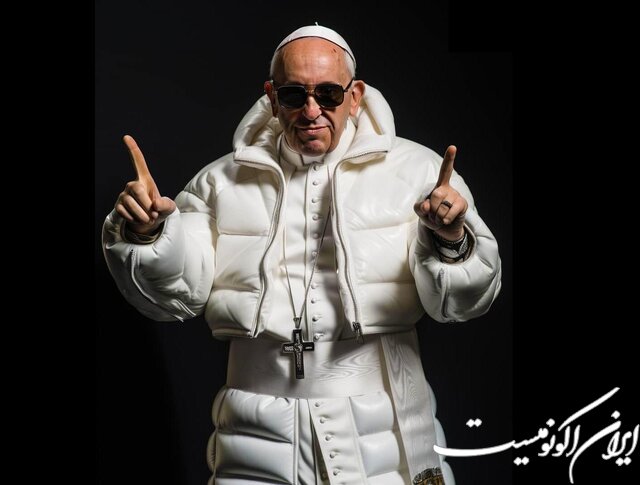

به عنوان نمونه در روزهای گذشته تصاویری جعلی از پاپ فرانسیس، رهبر کاتولیکهای جهان که یک کاپشن سفید پفدار از یک برند معروف پوشیده و یک گردنبند صلیب جواهرنشان به گردن دارد، در شبکههای اجتماعی ترند شد و بسیاری از کاربران آن را واقعی انگاشتند. حواشی مربوط به تصویر جعلی پاپ و تصاویر جعلی دستگیری ترامپ باعث شده تا پلتفرم میدجورنی (Midjourney)، آزمایش رایگان این ابزار را فعلا به حالت تعلیق دربیاورد.

در این رابطه کریسی تیگن، مدل و شخصیت تلویزیونی در توییتی نوشت: «من فکر کردم که ژاکت پفدار پاپ واقعی است و حتی شک نکردم که دوباره نگاهی به آن تصویر بیندازم. عمرا بتوانم با آینده تکنولوژی جان سالم بهدر ببرم!»

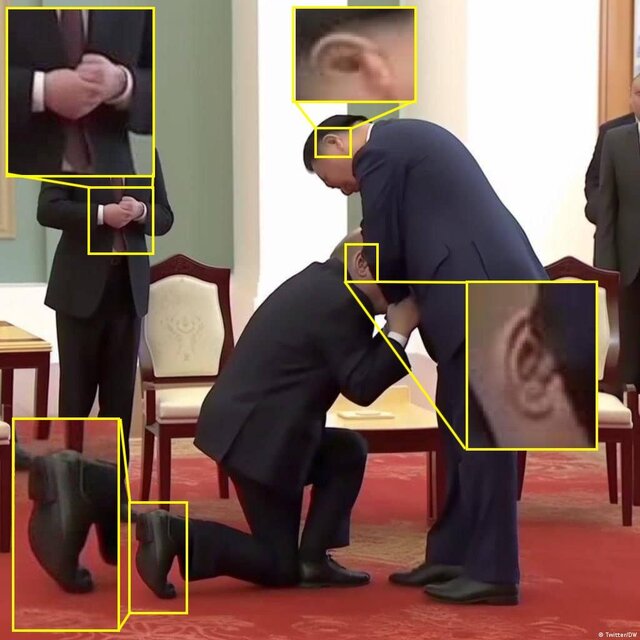

در نمونههای دیگر، تصاویر جعلی ساخته شده توسط هوش مصنوعی از بازداشت ترامپ، دستگیری ولادیمیر پوتین یا زانو زدن او مقابل شیجین پینگ، همتای چینیاش و همچنین تصاویر جعلی از ایلان ماسک که دست در دست خانم ماری بارا، مدیرعامل جنرال موتورز دارد هم جزوترندهای شبکههای اجتماعی در روزهای اخیر بود.

در توییتر فارسی هم تصاویری از کاراکتر مرد عنکبوتی در حال زیارت امام هشتم (ع) دست به دست میشود که با واکنش بسیاری از کاربران مواجه شده است. یکی از کاربران از پلتفرم میدجورنی که برپایه هوش مصنوعی تصویر خلق میکند خواسته تا مرد عنکبوتی را در حال توبه در حرم امام رضا(ع) به تصویر بکشد. بسیاری از کاربران این تصاویر را جالب و خندهدار میخوانند و برخی دیگر از قدرت هوش مصنوعی که توانسته مفاهیمی مانند «زیارت ارامگاههای مذهبی» و «توبه» را توسط کاراکتر سینمایی بیربطی به زیارت، مانند مرد عنکبوتی به تصویر بکشد متعجب شدهاند.

نگرانیها درخصوص توسعه تصویرسازهای مبتنی بر هوش مصنوعی

ساخت تصاویر جعلی با کمک هوش مصنوعی شاید در ابتدا جالب و بامزه به نظر برسد اما این تصاویر میتوانند بسیاری از کاربران را گمراه کنند، تصاویری از رویدادهایی بسازند که هرگز اتفاق نیفتاده یا حتی برای تولید تصاویر مستهجن یا پورنوگرافی از عکسهای کاربران به کار گرفته شوند.

هنری آژدر، کارشناس و مجری هوش مصنوعی در شورای مشورتی اروپایی آزمایشگاههای واقعیت متا میگوید که پیشرفت پلتفرم میدجورنی از زمان تاسیس شگفتانگیز بوده است و هشدار داد که این پلتفرمها میتوانند تصاویر جعلی بسیار متقاعدکنندهای ایجاد کنند و آرام آرام، اعتماد ما به رسانههای اجتماعی را از بین ببرند و دسترسی ما به حقیقت را سخت کنند.

آژدر مثال میزند و میگوید که در روزهای اخیر تصاویری بسیار واقعی از یک زلزله شدید که گفته شده در سال ۲۰۰۱ و در اقیانوس آرام، ایالات متحده آمریکا و کانادا را لرزانده منتشر شده که توسط کاربران شبکههای اجتماعی بسیار مورد توجه قرار گرفته است. آژدر میگوید که این زلزله هرگز اتفاق نیفتاده و تصاویری که از این رخداد منتشر شده تماما جعلی بوده و توسط هوش مصنوعی تولیده شده است.

اژدر همچنین رقابت توسعهدهندگان ابزارهای مبتنی بر هوش مصنوعی را به «رقابت تسلیحاتی» تشبیه کرد که در تلاش برای دیده شدن به عنوان اولینها و تصرف سهم بازار و کسب سود بیشتر، ممکن است نگرانیها را درخصوص مختل شدن امنیت کاربران و همچنین رعایت اخلاق را کنار بگذارند.

چگونه میتوانیم تصاویر جعلی ساخته شده توسط هوش مصنوعی را از تصاویر واقعی تشخیص دهیم؟

کارشناسان حوزه هوش مصنوعی تاکنون چندین روش کلی را برای شناسایی تصاویر جعلی از تصاویر واقعی ارائه کردهاند. خوشبختانه ابزارهای هوش مصنوعی هنوز خطا دارند؛ حتی اگر به سرعت در حال تکامل باشند. این خطاها بهخصوص زمانی که هوش مصنوعی بخواهد تصاویری از مردم و جمعیتی از افراد را نشان دهد بیشتر خودش را نشان میدهد. بنابر گفته کارشناسان، روشهای تشخیص این خطاها صرفا در زمان حاضر جواب میدهد و با گذر زمان طبیعتا این خطاها رفع میشوند و تشخیص تصاویر فیک از تصاویر واقعی سختتر خواهد شد.

۱. ظاهر «پلاستیکی» تصاویر ساخته شده توسط هوش مصنوعی

هنری آژدر میگوید که بسیاری از تصاویر تولیدشده توسط میدجورنی ظاهری «پلاستیکیمانند» و «فانتزی» دارند. بیشتر شکلها و آبجکتها دارای لبههای تقریبا نرم، درخشان و ظاهری پلاستیکی هستند. این ظاهر پلاستیکی و نقاشیمانند و فانتزی بهخصوص در تصاویری که در آنها چهره انسان به تصویر کشیده شده، بیشتر خودش را نشان میدهد. در تصاویر جعلی معمولاچهرههها بیش از حد خوب به نظر میرسند و پوست و موها بینقص ، اغراقشده و مصنوعی به نظر میرسند.

البته این ویژگی پلاستیکیمانند، بیشتر در آثار تولید شده توسط میدجورنی دیده میشود و این روش تشخیص ممکن است درخصوص تصاویر تولید شده توسط پلتفرمهای دیگر جواب ندهد.

۲. زوم کنید و دنبال تناقضات زیباییشناسی باشید

بسیاری از تصاویر تولیدشده توسط هوش مصنوعی ممکن است در نگاه اول واقعی به نظر برسند اما اگر بادقت بیشتری آنها را ببینید و زوم کنید متوجه خطاها و اشکالات آنها میشوید. در بسیاری از موارد، نوراز زاویههای عجیب و غریبی روی سوژهها تابیده، شکلهای ظریف درست به نظر نمیرسند و بسیاری از تصاویر ممکن است در لبهها دچار اعوجاج باشند یا اگر امتداد برخی از شکل ها را دنبال کنید ممکن است متناسب نباشند. در خصوص شکلهایی که قرینه دارند هم معمولا موارد بسیاری را میتوانید پیدا کنید که یکطرف شکلها درست است اما قرینه این شکلها خطاهای واضحی دارند.

۳. به تناسب بدن دقت کنید

دقت کنید و ببینید که افراد در تصاویر دارای تناسب اندام صحیح و منطقی هستند؟ عدم وجود تناسب میان اندام انسانها در تصاویری که هوش مصنوعی تولید میکند رویه غیرمعمولی نیست. ممکن است دستها خیلی کوچک باشند یا انگشتان خیلی بلند. ممکن است برخی در دستانشان به جای پنج انگشت، چهار یا شش انگشت داشته باشند و حتی سر افراد کمی بیش از حد بزرگ باشد و به بقیه بدن نخورد یا حتی ابروها و دندانها اغراقآمیز به نظر برسند.

برای مثال در این تصویر حالت گوش پاپ بزرگتر از حد معمول به نظر میرسد، شیشههای عینک او نامتقارن است. سایهی عینک پاپ روی صورتش درست نیست. زنجیر گردنبند صلیبی که پاپ به گردن آویخته هم تنها به یک سمت صلیب متصل شده است. در پایین تصویر، دست راست پاپ از دست دیگرش بلندتر اما دارای انگشتان کوچکتری است. وسیلهای که در دست پاپ قرار دارد هم مشخص نیست که چه شیئی است. این موارد نشانههای واضحی است که این تصویر توسط ابزارهای مبتنی بر هوش مصنوعی ساخته شده است.

در تصویر بالا هم که رئیسجمهوری روسیه را در حالت زانو زدن مقابل شی جینپینگ، همتای چینیاش به تصویر کشیده، خطاهای واضحی به چشم میخورد. در این تصویر کفش راست پوتین بهطور نامتناسبی بزرگ و پهن به نظر میرسد. ساق پایش دراز و ناهمگون است. گوش پوتین و همینطور شیجینپینگ هم طبیعی به نظر نمیآیند.

۴. به پسزمینه عکسها دقت کنید

پس زمینه تصاویر میتوانند نشان دهند که آیا این تصاویر واقعی هستند یا توسط هوش مصنوعی ساخته شدهاند. در پسزمینه تصاویر ممکن است برخی از اجسام، نامتناسب و دفرمه به نظر برسند یا المانهایی بیربط نسبت به سوژه اصلی در پس زمینه تصاویر دیده شوند. در موارد بسیاری هم بکگراند تصویر محو نمایش داده میشود و به صورت مصنوعی تار به نظر میرسد.

در برخی موارد هم حتی دیده شده که هوش مصنوعی افراد و اشیاء حاضر در پشت صحنه تصویر را به صورت تکراری یا دو بار در تصویر قرار داده است.

۵. منبع تصاویر را پیدا کنید

اگر مطمئن نیستید که یک تصویر واقعی است یا توسط هوش مصنوعی تولید شده، سعی کنید منبع انتشار آن تصویر را پیدا کنید. بررسی کنید که آیا تصویر از منابع رسمی منتشر شده یا صرفا در حال دست به دست شدن در شبکههای اجتماعی و یا توسط اکانتهای نامعتبر است. با خواندن نظرات منتشر شده توسط سایر کاربران زیر تصویر مورد نظر نیز ممکن است بتوانید اطلاعاتی را در مورد جایی که اولینبار تصویر را منتشر کرده پیدا کنید.

به عنوان راهحل دیگر، میتوانید جست وجوی عکس معکوس هم انجام دهید. برای انجام این کار میتوانید تصویر مشکوک را در ابزارهای آنلاینی مانند موتور جستوجوی یاندکس، گوگل ایمیج ریورس سرچ، تاینیآی و غیره آپلود کنید و منبع تصویر را پیدا کنید.

جمع بندی

در حال حاضر بسیاری از تصاویری که توسط هوش مصنوعی تولید میشوند، با کمی تحقیق قابل آشکار شدن هستند اما تکنولوژی روز به روز در حال پیشرفت است و احتمالا اشتباهات هوش مصنوعی در آینده نادرتر خواهد شد.

روشهایی که در بالا عنوان شد هم تنها سرنخها و ردپاهایی از فناوری هوش مصنوعی در تولید تصاویر را نشان میدهند و ممکن است این روشها هم با خطا همراه باشند.

در صورت شک داشتن به اینکه تصویری واقعی است یا تقلبی، علاوه بر آزمایش روشهایی که پیشتر معرفی شد، مشاهدهی دوباره تصاویر مشکوک با عینک منطق و عقل سلیم، باورنکردن هرچیزی که در فضای آنلاین دست به دست میشود، تکیه بر رسانههای معتبر و پرهیز از اشتراکگذاری تصاویری که مشکوک به نظر میرسند بهترین راهکار به نظر میرسد.